Ein Anruf mit einer vertrauten Stimme kann heute brandgefährlich sein. Kriminelle nutzen zunehmend Künstliche Intelligenz, um Stimmen von Kindern, Enkeln oder Freunden täuschend echt nachzuahmen. Was wie eine echte Notsituation klingt, ist oft ein perfider Betrug. Zum Safer Internet Day am 10. Februar warnt die Verbraucherzentrale Brandenburg eindringlich vor dieser neuen Masche.

Perfide Masche mit vertrauter Stimme

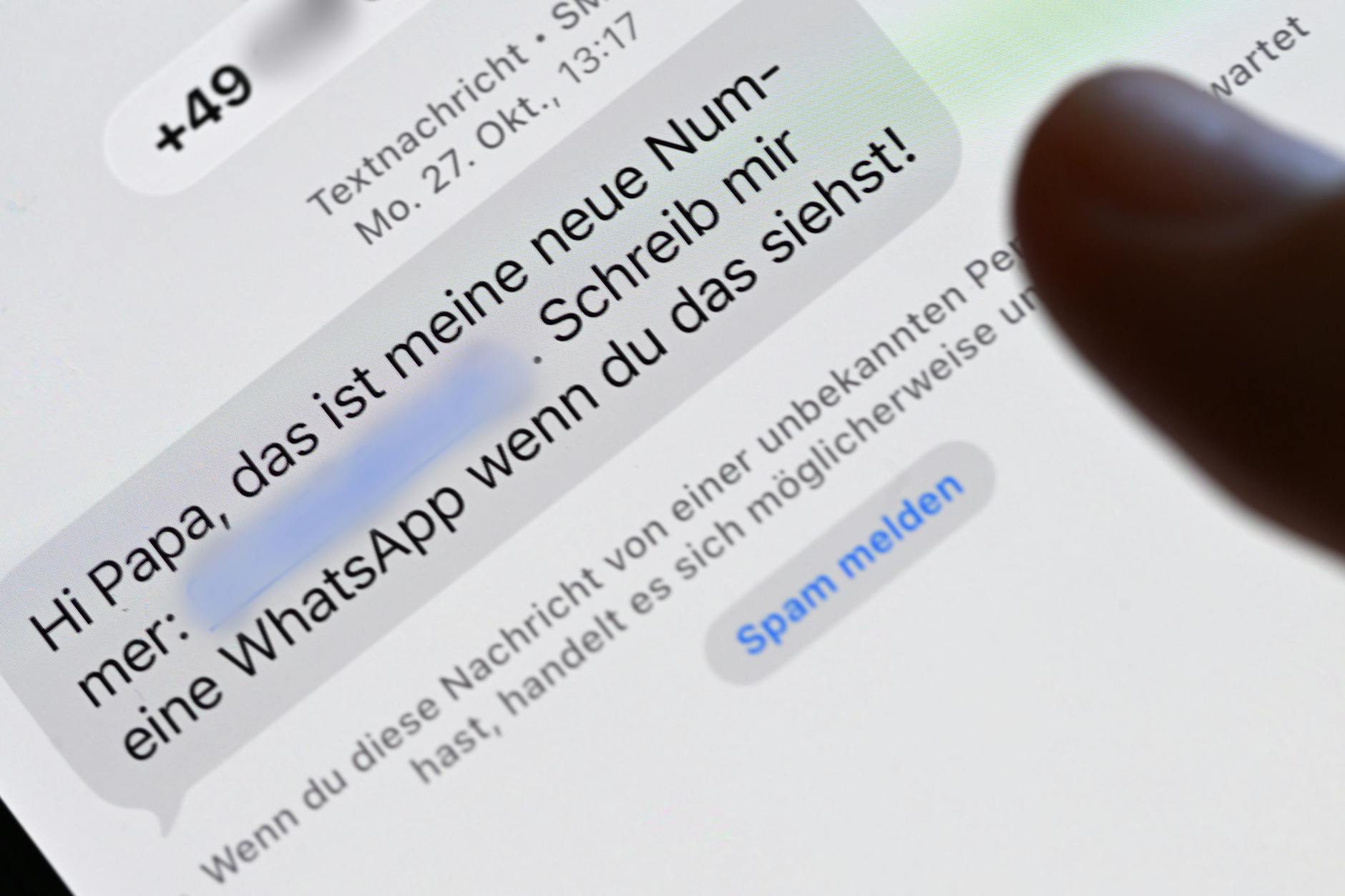

Das Vorgehen ähnelt dem bekannten Enkeltrick. Die Täter behaupten, eine nahestehende Person befinde sich in großer Not. Sie sprechen von Unfällen, Krankenhausaufenthalten oder finanziellen Problemen. Der entscheidende Unterschied liegt in der Stimme. Mithilfe von KI klingt der Anrufer plötzlich wie der eigene Sohn oder die Tochter.

„Der eingesprochene Hilferuf am Telefon ist dadurch oftmals schwer als Fake-Anruf zu erkennen“, sagt die Digitalexpertin Michèle Scherer von der Verbraucherzentrale Brandenburg. Viele Betroffene geraten in Panik und handeln überstürzt.

Für die Fälschung genügen den Betrügern oft kurze Sprachproben. Diese finden sie in sozialen Netzwerken, Videos oder Sprachnachrichten. Mit speziellen Programmen entstehen daraus sogenannte Deepfakes. Dabei handelt es sich um künstlich erzeugte Tonaufnahmen, in denen Menschen Dinge sagen, die sie nie gesagt haben.

„Am Telefon sind diese Fälschungen nur schwer zu erkennen“, warnt Scherer. Es gibt manchmal unnatürliche Pausen oder merkwürdige Gesprächsverläufe. Unter Stress fällt das vielen nicht auf. Betroffen sind längst nicht mehr nur ältere Menschen. Auch Eltern und junge Erwachsene geraten immer häufiger ins Visier.

So schützen Sie sich vor KI-Schockanrufen

Die Verbraucherzentrale rät deshalb zu Besonnenheit. Niemand sollte sich am Telefon unter Druck setzen lassen. Im Zweifel ist es sinnvoll, das Gespräch zu beenden und die angebliche Person selbst über eine bekannte Nummer zurückzurufen. Auch gezielte Kontrollfragen können helfen, einen Betrug zu entlarven.

Sensible oder Geld betreffende Daten sollten grundsätzlich nicht am Telefon weitergegeben werden. Bei Verdacht empfiehlt die Verbraucherzentrale, den Vorfall zu dokumentieren und Anzeige bei der Polizei zu erstatten.